Hochauflösende Planeten- und Mondfotos erstellen

Vor mehr als 7 Jahren habe ich mit meinem Hobby Astrofotografie angefangen - da hatte ich mit meinem ersten Teleskop (Celestron SC 8'' auf einer CG-5 Montierung) den Mond beobachtet, aber da noch kein Foto gemacht. Bereits da war mir aber klar, dass ich die Planeten, Kleinplaneten und Monde fotografieren möchte. Seit dem ist zwar auch Deep-Sky dazu gekommen, aber in der Hauptsache mache ich noch Planeten- und Mondfotos. Es sind im Ganzen über 70 Beiträge mit Fotos auf meinem Blog zu finden. Die besten davon habe ich zusätzlich und in besserer Auflösung auf Flickr in einem Photostream veröffentlicht. Wobei klar erkennbar wird, dass ich mich immer weiter im Thema Bildbearbeitung verbessert habe.

Ich hatte gerade etwas Zeit mich weiter in das Thema Planeten- und Mond-Videobearbeitung einzulesen. Dabei habe ich auch das alte Wissen aufgefrischt und habe hier ein paar Beispiele erstellt, die die eine oder andere Einstellung in der Software und meine Erfahrung bei der Bearbeitung anschaulich darstellt.

Kleiner Hinweis von mir: Deutsch ist nicht meine erste Sprache, daher werden hier sicher einige Fehler zu finden sein. Bitte meldet mir diese in den Kommentaren oder sendet mir diese per Mail. Danke.

Voraussetzungen

Diese Anleitung wird wohl den blutigen Anfänger vor einer (kleinen?) Herausforderung stellen, aber mein Ziel ist es dennoch gewesen möglichst viele Hobby-Astronomen und Astrofotografen mitzunehmen.

Ich habe auch alle wichtige Links, zu weiterführenden Themen, beigefügt. Das sind alles Quellen, die ich ebenfalls für meine Arbeit einbezogen habe und ohne die auch ich nie vernünftige Fotos erstellen könnte. Der Vorteil dieser Anleitung ist, dass man diese Quellen an einem Ort zusammen findet, was ich persönlich nie im Netzt vorgefunden habe und hier erstmals gemacht habe. Bei Fragen könnt ihr gerne Kommentare nutzen und ich werde diese Anleitung weiter verbessern und anpassen.

Was braucht man also, um gute Bilder von Planeten und Mond zu erstellen?

Kurz zum Teleskop

Es sollte schon ein Teleskop sein, das bei sehr gutem Seeing und Transparenz ein paar Details erkennen lässt (8'' Teleskop und aufwärts). Ein Newton-Teleskope wird schnell zu schwer. Daher ist ein Maksutov-Teleskop oder ein Schmidt-Cassegrain-Teleskop oft die bessere Wahl. Auch die Kamera sollte zum Teleskop passen, wofür es online auch mehrere Rechner gibt.

Für eine gute Aufnahme muss das Teleskop auch ordentlich Kollimiert werden, versteht sich von selbst. Die Position der Kamera genau in der optischen Achse ist sehr wichtig. Hier hilft oft Software und manchmal auch die Aufnahmesoftware. Auch die Unterstützung durch IR - Passfilter (z.B. 685 nm) und einen Atmosphärischen-Dispersions-Korrektor (ADC) ist nicht zu vernachlässigbar.

Auch das Auskühlen von so einem geschlossenen System kann sehr lange dauern. Bei einem SC11'' kann man unter Umständen ganze 2 Stunden dafür einplanen.

Das Thema Teleskop wäre ein eigenes, sehr ausführliches Thema. An dieser Stelle reicht es uns paar Eckpunkte zu kennen.

Aufnahmesoftware

Für die Aufnahme von Planeten und Mond nutze ich immer FireCapture. Da gibt es kaum eine Alternative, da dieses Programm einfach zu bedienen ist, viele Funktionen hat und viele Planetenkameras unterstützt.

Fileformat

Die Files speichere ich immer im SER-Format, damit ich 16 Bit speichern kann und beim Speichern keine weitere Komprimierung durchgeführt wird. Ich will die Rohdaten der Kamera haben und nicht bereits beim Speichern ein Teil der Daten verlieren. In FireCapture würde auch AVI-Format gehen, der ebenfalls Rohdaten liefert aber auf 8 Bit beschränkt ist. Das muss aber nicht in jedem Programm so sein.

Weiterhin habe ich in FireCapture es so eingestellt, dass der Filename das Objekt, Kamera, Datum, Zeit, Gain und Belichtungszeit beinhaltet.

Aufnahmesteuerung

Hinweis: Um die Atmosphärischen-Dispersion möglichst klein zu halten nutze ich eine S/W-Kamera, mit Filtern.

Um an die Farben zu kommen benötigt man hier Farbfilter (RGB-Filter) und einen weiteren Filter für die Helligkeit (L-Filter, beachte weiter Unten Abschnitt Bearbeitung und Luminanz - scharfes sehen!).

Um an die Farben zu kommen benötigt man hier Farbfilter (RGB-Filter) und einen weiteren Filter für die Helligkeit (L-Filter, beachte weiter Unten Abschnitt Bearbeitung und Luminanz - scharfes sehen!).

Das Histogramm in FireCapture ist meine erste Anlaufstelle bei der Steuerung der Aufnahme. Für Jupiter (etwa 2 Minuten) stelle ich die Belichtungszeit, bei möglichst hohen Gain, so ein, dass das Histogramm die Werte für:

- R 80-90%

- G 80-90%

- B 80-90%

erreicht. Bei Saturn (etwa 3 Minuten)

- R ~50%

- G ~50%

- B ~30%

- R 80-90%

- G 60 - 70%

- B 30-40%

Achtet darauf, dass das Seeing und Transparenz schwankt (Wetter bedingt) und dadurch das Histogramm kurzfristig 100% überschritten werden kann (besonders beim hellen Mond). Ab da verliert man wieder Daten (Überbelichtung) und das sollte ja nicht sein. Also lieber etwas weniger Belichtungszeit oder Gain einstellen.

Pro Aufnahme (Filter, Kanal) nehme ich 2000 bis 5000 Frames auf, wovon ich 5% bis max 50% später in der Bearbeitung verwenden werde.

Software

Ich benutze in dieser Anleitung folgende Software, nenne aber auch paar Alternativen:

Bearbeitung

Fangen wir ganz vorne in der Bearbeitung an. Ich habe als Ausgangssituation immer vier Videos (LRGB) von einem Objekt (sagen wir mal von Jupiter).

Tipp: eine Farbkamera kommt mir in Deutschland nicht in Frage. Allerdings gibt es hier in der letzten Zeit starke Fortschritte. Diese Anleitung ist aber leicht für RGB-Aufnahmen anzuwenden (Vorverarbeitung beachten).

- Vorverarbeitung

- Stacking

- Schärfen der Bilder

- Farben kombinieren

- Derotation

Vorverarbeitung - PIPP

Ob das Objekt in der Aufnahme mittig ausgerichtet ist oder nicht, spielt kaum eine Rolle. Ich würde es dennoch mit Hilfe von Planetary Imaging PreProcessor (PIPP) mit Standardeinstellungen für Planeten und Mond stabilisieren. So kann man die Ergebnisse auch besser untereinander vergleichen, was durchaus nicht unwichtig ist (dazu später mehr).

|

| Vorbereitung in PIPP - Option Planetary ist ausgewählt und stellt alles automatisch ein |

Wenn man eine Farbkamera benutzt, so kann man hier vor der Bearbeitung die RGB-Aufnahmen in einzelne Farben aufteilen.

|

| PIPP - Monochrome Conversion |

Stacking - AutoStakkert

AutoStakkert ist wesentlich besser im Stacking von Planetenvideos und gleichwertig mit anderen Programmen beim stacking von Mondaufnahmen. Für mich gibt es keinen Grund hier zwei unterschiedliche Workflows zu entwickeln und daher nutze ich immer AutoStakkert (AS!2 oder AS!3).

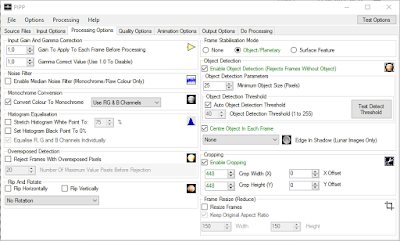

Im wesentlichen steuert man das Stacking in AS!2 durch die Einstellungen in zwei Fenstern. Das Hauptfenster stellt die Parameter für die Analyse und das Stacken von Planeten oder Mondaufnahmen ein (hier kann man auch Videos der Sonne stacken) und das rechte Fenster mit dem Objekt steuert die Feinheiten bei der Auswahl der Bilder. Das Verfahren für Planeten oder Mond unterscheidet sich kaum, nur die Einstellungen sind etwas unterschiedlich.

Im linken Fenster nutze ich für Planeten stets folgende Einstellungen:

|

| AS!2 - Einstellungen für Planeten |

Unter Open (Punkt 1) kann man einen oder mehrere Files gleichzeitig zur Bearbeitung wählen (batch processing). Unten rechts kann man sehen, dass hier nur ein File offen ist.

Image Stabilization

Unter Image Stabilization ist die Option für Planeten gewählt und die Dynamic Background sorgt dafür, dass auch deutlich hellere Polkappen klar erkannt werden und dadurch das Stacking besser wird

Quality Estimator

Der Quality Estimator wird sofort beim öffnen eines Files angewendet und im rechten Fenster wird pro Bild im Video ein Wert für Qualität angezeigt. Der Wert für Noise Robust sollte bei Farbkameras bei max. 6 und bei S/W-Kameras bei 4 liegen. Je nachdem ob ein Bild wenig Rauschen hat, wie bei den modernen Kameras, kann der Wert auch kleiner eingestellt werden.

Bei Venus und ähnlichen Aufnahmen ist es besser das Verfahren Edge zu verwenden (alles was nicht rund und durch dunklen Hintergrund umgeben wird). Sonst ist immer Gradient besser.

Die Option Local APs (Alignment Points, deshalb Ausrichtungspunkte) sorgt dafür, dass beim stacking nicht das ganze Bild des Objektes gestackt wird, sondern jede einzelne Region einzeln gesteckt wird und das Ergebnis jeder dieser Region am Ende zum Mosaik des Objektes zusammengestellt wird. Das ist wesentlich besser als Global. Dennoch, bei manchen Aufnahmen entstehen Artefakte beim Erstellen von diesen Mosaik, sodass nur Global funktioniert. Es kann aber auch sein, dass die größe der APs falsch gewählt wurde und größere APs ein besseres Mosaik erzeugen.

Habe ich alles eingestellt, so kann ich mit Analyse starten (Punkt 2). Hier würde ich an den Einstellungen auch nichts ändern.

Quality Graph und Stack Options

Dies gehört quasi noch zu der Analyse, bevor man weitere Parameter im rechten Bereich des linken Fensters einstellt. Die Grafik in der Mitte zeigt folgendes:

- graue Kurve zeigt die Frames in der Reihenfolge wie die Aufgenommen wurden und welche Qualität diese haben.

- die grüne Kurve zeigt den Verlauf der Qualität über alle Frames im Ganzen.

Uns interessiert nur die grüne Kurve!

In manchen Aufnahmen geht die grüne Kurve (die Anzeige für Qualität der Bilder im Video) nicht so schnell runter und in manchen Aufnahmen geht sie direkt am Anfang sofort stark oder über den Verlauf sehr schnell runter. Hier ein Beispiel für Fall 3:

|

| AS!2 - Qualität geht schnell runter - ein Baum stand im Weg! |

Die grüne Kurve zeigt uns also, wie viele Bilder wirklich gut sind. Im ersten Fall, wenn die Kurve nicht so schnell runter geht, kann man mehr Bilder stacken. In den anderen beiden Fällen wird man nur wenige Bilder behalten können.

Hat man aber bereits wenige Bilder, weil man nur eine Minute und etwa 2000 Bilder aufgenommen hat, so sind hier 5-30% viel zu wenige um einen guten SNR-Wert zu erreichen (Signal-Rausch-Verhältnis, dazu später mehr). Bei 3000 Bildern kann man durchaus auch nur 30% nehmen, selbst wenn 40% der Bilder OK sind. Man muss also sehr viel experimentieren.

Anhaltspunkte:

- nur die besten Bilder mit Bildqualität von >85% wählen

- aber minimum 100 - 1000 Bilder, die zum Stacken gut geeignet sind

- beim guten Seeing sind um die 40% ideal

Jetzt wird auch klar, warum beim Video mit 3000 Bildern das Seeing relativ stabil bleiben sollte! Und bei der S/W-Fotografie das ganze 4 mal.

Tipp: Klickt man in den Bereich des Graphen und hält dabei die Taste ALT gedrückt (ALT+Mausklick), so stellt sich automatisch ein Wert bei Stackgröße ein. Jetzt wird auch ein Bild rechts angezeigt, welche sich an dieser Stelle der grünen Kurve befindet. So kann man schnell die optimale %-Zahl finden, in dem man entlang der grünen Kurve das erste Bild mit Bildqualität von >50% findet (als Anhaltspunkt).

Aber nicht vergessen: zu wenige Bilder (weit unter 1000 Bilder) sind später beim Schärfen und Deconvolution auch nicht gut.

Aber nicht vergessen: zu wenige Bilder (weit unter 1000 Bilder) sind später beim Schärfen und Deconvolution auch nicht gut.

Normalize Stack und Sharpened

Es ist oft eine gute Hilfe, wenn man die vielen Videos schnell untereinander vergleichen kann. Dafür sind diese beiden Optionen gedacht. Wenn man mehrere Aufnahmen hat, dann will man relativ schnell wissen welche sich davon lohnt weiter zu bearbeiten.

Mit normalisierten Stack, sagen wir auf etwa 75-80% des Histogrammes, hat man später auch in der Bearbeitung leichteres Spiel. Man muss nur aufpassen, dass beim schärfen das Histogramm weiter angehoben wird und man deshalb nicht mehr als 80% hier einstellen sollte. Die Option ist aber nicht notwendig, da man das Histogramm später auch selbst angleichen kann.

Sharpened hingegen ist wirklich nur für schnelle Auswahl zwischen vielen Videos gedacht und auf keinen Fall für weitere Bearbeitung geeignet.

Drizzle-Funktion

Auf die Drizzle-Funktion verzichte ich in der Regel, da ich oft keine Barlow-Linse nutzen kann (große Brennweiten, mehr als F/15, sind beim schlechten Seeing kontraproduktiv) und eine passende Vergrößerung des Objektes (Kamera-Teleskop müssen abgestimmt sein) bei der Aufnahme anstrebe. Das wäre ein eigenes, sehr ausführliches Thema und darauf gehe ich hier nicht ein.

In diesem Beispiel habe ich Beispielvideos von Jupiter ohne Barlow-Linse aufgenommen und das Objekt ist ohne Drizzle relativ klein. Also habe ich die Ergebnisse des Stackings für diese Anleitung mit Drizzle-Faktor 1,5x vergrößert (Super Resolution hat aber bei Planentenaufnahmen kaum einen Effekt, bei Mond und Sonne hat man da schon mehr Chancen auf mehr Details). Dennoch, mit Barlow-Linse hätte ich mehr Details haben können, da die maximale Auflösung des Teleskops und die theoretische Detailabbildung der Kamera ausgenutzt werden.

Mond und Sonne

Für Mondaufnahmen nehme ich folgende Einstellungen (wobei bei der Sonne die Option "Last Steck as Reference" sehr hilfreich sein kann):

|

AS!2 - Einstellungen für Mond oder Sonne

|

Wobei es je nach Fall der Expand- oder Cropped-Modus ist. Bei Cropped habe ich in jedem Bereich gleich viel Information und damit ein besseres Signal-Rausch-Verhältnis und damit SNR-Werte. Dazu aber später mehr.

Unten rechts kann man sehen, dass hier ganze 27 Files offen sind - deshalb Batch-Modus. Es handelt sich um ein Mosaik des Halbmondes. Diese einzeln per Hand zu bearbeiten wäre sehr umständlich und daher nutze ich hier diesen Batch-Modus von AS!2 oder AS!3.

Wenn man Mond-Mosaik erstellt, und der Mond hat sehr viele unterschiedliche Mustern - mal kleine Krater, mal riesige Meere, muss man die AP-Größe variieren. Ich benutze hier daher oft AP-Größe von 48 oder 104. Bei einzelnen Bildern muss man variieren und vergleichen. Zumal Seeing und Transparenz bei der AP-Größe ebenfalls eine Rolle spielen. Hier hilft AS!3, da es bereits automatisch variable AP-Größen vorgeben kann - perfekt für Mond-Mosaik im Batch-Modus!

Automatische APs setzen und Auto AP Size

Im rechten Fenster kann man das wichtigste in AS!2 einstellen - die AP-Größe. APs (Alignment Points, zu Deutsch Ausrichtungspunkte), beeinflussen die Algorithmen beim Stacken. Sind diese falsch gesetzt oder in der falschen Größe, wird das ganze Bild nichts.

|

AS!2 - Rechtes Fenster von AS!2 für die Einstellung von APs

|

Hat man die Analyse abgeschlossen (Punkt 2), kann man die APs setzen. Je größer ein AP, um so öfters kann der Algorithmus Kanten finden, an denen er das ganze Bild ausrichtet. Dabei trifft dieser Algorithmus die Wahl, wie gut diese Region in dem jeweiligen einzelnen Bild eines Videos geeignet für das Endergebnis ist. Das gesamte Objekt muss dabei durch APs bedeckt werden - auch gerne mit APs in unterschiedlichen Größen. In AS!2 gibt es dazu keine automatische Funktion, diese ist erst ab AS!3 verfügbar. In AS!2 kann man und muss man das manuell setzen.

Hat man größere APs, so findet AS!2 besser die gleichen Kanten in allen Bildern, kann diese also besser verfolgen, aber kleinere Details gehen unter Umständen unter. Auch die Auflösung des Teleskops und der Kamera spielen eine große Rolle, genauso wie die Photonenausbeute des Chips. Deshalb bleibt nichts weiteres als ausprobieren was einem ein besseres Ergebnis liefert (einfach in FW vergleichen). Wichtig ist: die Größe und Position der APs ist entscheidend! Daher ist die Automatik oft überfordert.

Hier ein Beispiel zwischen größeren, 48ger und kleineren, 24ger APs. In meinem Beispiel ohne Barlow-Linse gewinnen leicht die 24ger APs.

|

Größe der APs: 48ger vs 24ger

|

Die ganz kleinen Details, besonders die kleinen Stürme im Süden und die Flecken im Norden sind erkennbar. Auch getrennte Sturmbänder in den Polarregionen sind besser zu erkennen. In der Mitte (um Äquator herum, bei etwas größeren Mustern) ist kaum ein Unterschied zu sehen. Also wurden offensichtlich mit kleineren APs die Details im Norden und im Süden besser berücksichtigt. Die Unterschiede sind sehr klein aber man kann es sehen.

Als Faustregel kann man festhalten: automatische APs setzen ist in AS!2 gut, kann aber keinen Unterschied zwischen feinen und groben Strukturen verfolgen. Deshalb ist es besser, noch eigene APs in unterschiedlicher Größe zu setzen. Oder man nutzt die neue Funktion von AS!3 die APs automatisch in unterschiedlicher Größe zu setzen.

In vielen Fällen wird die automatische Platzierung der APs gute Arbeit leisten. Aber, hat man Monde von Jupiter (oder deren Schatten auf der Oberfläche) im Bild, oder wenn man Saturn und seine Ringe aufnimmt, so sollte man immer manuell ein paar APs setzen. AS!2 und AS!3 erkennt diese Objekte oder Strukturen der Objekte nicht richtig und nicht automatisch (die APs werden mehr oder weniger per Zufall gesetzt). Da muss man also etwas nachhelfen. Einfach kleine APs auf die Monde oder Schatten setzen, oder da wo die Ringe von Saturn mit dem Saturn scheinbar verschmelzen. Dabei können sich mehrere APs überlappen oder sogar aufeinander liegen. Dadurch unterstützt man Algorithmen bei der Arbeit.Kurz das Thema Signal-Rausch-Verhältnis (SNR)

Ist die Analyse (Punkt 2) abgeschlossen, so muss man die Stackgröße wählen. Unter Stack Options habe ich 10%, 25% und 50% der Gesamtbilder eines Videos eingestellt. Je nach Seeing und Transparenz wähle ich aus diesen drei das beste Ergebnis. An manchen Tagen behalte ich auch nur 5%. Dann geht bei der Schärfung halt nicht mehr viel. Optimal sind um die 20 - 40%.

Unterschiede zwischen Stackgrößen

Was ist der genauer Unterschied? Je mehr Bilder man stackt, um so besser ist das Signal-Rausch-Verhältnis (SNR). Man kann die SNR auch durch mehr Belichtungszeit pro Bild verbessern, was aber bei Planeten nicht erwünscht ist (Stichwort lucky imaging).

Was ist, wenn man also gutes Seeing und gute Transparenz hat und 3000 Bilder aufgenommen hat? Hier ein kleiner Vergleich, zwischen 10% und 50%:

|

| Vergleich zwischen 10% und 50% Frames von 3000 bei gutem Seeing |

Bearbeitung der Bilder ist nicht ganz gleich. Durch das bessere SNR im 50%-Stack ist auch bei der Bearbeitung viel mehr Schärfung möglich. Auch der Kontrast ist deutlich stärker. Aber dazu gleich mehr!

Schärfen der Bilder - Astra Image

Wie bereits im Kapitel zum Thema SNR gesehen, ist das wichtigste für das Schärfen möglichst viele Frames zum Stack zu addieren um ein besseres SNR zu haben - weil wir eben pro Bild möglichst kurz belichten wollen, geht das nur über die Masse der Bilder!

Zum schärfen gibt es sehr viele Verfahren und Tools. Eine Zeit lang habe ich RegiStax6 für Wavelet genutzt, dann in Fitswork die unterschiedlichen Verfahren, einschließlich Deconvolution ausprobiert und bin schließlich beim Verfahren Deconvolution geblieben - allerdings nicht mit Fitswork.

Für Deconvolution gibt es wieder viele Tools: DStation, ImPPG und nicht zuletzt bereits genanntes Fitswork. Nachdem ich alle diese Tool genauer angeschaut habe, war ich immer noch unzufrieden, auch wenn die Ergebnisse bereits besser als mit Wavelets waren.

Nach der Suche für bessere Schärfung von Bilder bin ich dann bei den kostenpflichtigen Tools geladet. Neben den sehr teuren Lösungen wie MaxIm DL, gab es moderate wie PixInsight und Astra Image. Nachdem ich einige positive Vergleiche und Erfahrungen zu Astra Image gelesen habe, habe ich mich dafür entschieden und habe es gekauft.

Deconvolution

Astra Image liefert viele, sehr unterschiedliche Deconvolution-Verfahren mit. Was an sich schon großer Vorteil ist, da viele Bild mit unterschiedlichen Verfahren mal besser oder schlechter werden. Für Planeten- und Mondaufnahmen ist im wesentlich das Verfahren (Methode) Lucy Richardson, mit Blur Kernel Lorentzian oder Gaussian interessant.

Tipp: ab hier arbeite ich immer mit TIF (TIFF)-Format, da dieser von allen genutzten Anwendungen unterstützt wird und Daten ohne Verluste speichert.

Tipp: Die Zwischenergebnisse der Bearbeitung vergleiche ich in Fitswork mit der "Blink-Images"-Funktion um bessere Entscheidung für weitere Bearbeitung zu treffen.

Unser Ausgangsbild im TIF-Format für die Schärfung mit Deconvolution ist ja das mit 50% gestacktes Video aus 3000 Bilder. Also dieser Stack hier:

|

| 50% Stack von 3000 Bilder |

Wie man sehen kann, ist das Seeing oder Transparenz alles andere als perfekt gewesen. Die Details sind kaum zu erkennen. Nun öffne ich das Bild in Astra Image, gehe auf Deconvolution - Schärfen und wähle dort die Methode Lucy Richardson und als Kernel Lorentzian. Der Rest ist dann eine Sache des Geschmacks und der Rohdaten. Ich habe hier 14 Iterationen, Blur kernel size von 2 und Deconvolution strength von 8 gewählt.

|

| AI - Mögliche Einstellung für Deconvolution |

Ich habe bereits weiter oben ein Beispiel gezeigt, wie das Ergebnis mit 10% Stack im Vergleich zum 50% Stack ausschaut. Für 10% Stack kann ich hier beim Parameter Stärke nur die Hälfte einstellen!

Der Blur kernel size sagt etwas über die eingesetzte Optik (Öffnung), das Seeing und Transparenz aus - da dieser direkt zur Bestimmung von Schärfe, Kantenerkennung und mehr genutzt wird. Im Grunde kann man, wenn man den FWHM-Wert kennt, genau diesen hier eintragen (nicht uneingeschränkt). Das Problem ist, dass man den FWHM-Wert nie genau kennt.

Planten wird man in der Regel nur bei gutem und sehr guten Seeing machen. Daher sind Werte zwischen 1 (sehr gut) und 3 (gut) normal. Ich persönlich mache auch Fotos bei schlechtem Seeing und habe daher oft Werte von 4 bis 6 (Mittel-Gut bis Mittel). In diesem Bild kann man bei “Blur kernel size” sehen, dass ich mit 2 sehr gutes bis gutes Seeing hatte! Trage ich zu viel ein, wird das Bild stark überschärft. Trage ich 1 ein, wird es nicht richtig scharf. Natürlich gilt das alles nur, wenn man das Bild am Teleskop perfekt scharf eingestellt hat (ein anderes Thema).

Den Rest macht Deconvolution für uns - hier muss man rumprobieren! Das einzige, worauf man achten muss, wenn man die Deconvolutionsstärke hochdreht, dass es nicht zu viel Rauschen erzeugt. Das will man auf gar keinen Fall haben. Lieber etwas weniger Stärke, dafür aber mehr Iterationen (10-16) machen lassen!

Astra Image (AI) Multiscale Sharpen

In Astra Image gibt es noch ein weiteres, sehr mächtiges Werkzeug neben Deconvolution. Multiscale Sharpen kann man so einstellen, dass für jede Detailgröße eine eigene Stärke beim Schärfen angewendet wird (etwa so wie bei RegiStax6 für Wavelet). Das ist genau richtig für Planeten- und Mondfotos und ist bereits bei Wavelets von RegiStax6 sehr stark! Hier muss man immer sehr viel probieren. Ich habe gute Erfahrung damit gemacht, 1-2 Stärken bei Deconvolution einzusparen und dafür noch mal die Details (je nach Größe) durch Multiscale Sharpen individuell nachschärfen.

Das Bild von Oben kann man zu 100% genau so erzeugen, wenn man 2 Stärken bei Deconvolution einspart und wie im folgenden Bild Multiscale Sharpen anwendet:

|

| AI - Multiscale Sharpen |

|

| Deconvolution vs etwas weniger Decon + Multiscale Sharpen |

Alternative FitsWork und co.

Warum aber nicht Fitswork oder andere Software anstatt Astra Image für Deconvolution nutzen? Ist ja schließlich auch noch kostenlos! Der Grund hierfür ist, dass nur wenige der Programme die Deconvolution-Methode "Lucy Richardson" unterstützen. Die Programme die die Methode unterstützen sind meist sehr teuer und die Methode ist nicht gut umgesetzt. Zudem ist AI bei Kontrasten besser und es bietet noch viele andere Funktionen, die ich gleich noch ansprechen werde, um schärfere Bilder zu erzeugen. Hier ein kleiner Vergleich zwischen Fitswork und Astra Image, am gleichen Ausgangsbild mit je bestem Deconvolution geschärft.

|

| Deconvolution in Astra Image und FitsWork |

Der Unterschied zwischen Astra Image und FitsWork ist kaum zu erkennen. Da muss man schon gut hinschauen um zu erkennen, dass bei AI-Bild mehr Kontrast vorhanden ist und das Bild im ganzen etwas schärfer ausschaut. Mehr ging bei FitsWork nicht und manche Details in den Wirbelstürmen und im Mittelband, wo viele kleine Details nebeneinander liegen, sind sogar verschwommen. Bei AI habe ich alle Details behalten können und nichts ist verwischt.

Habe ich die besten Einstellungen für Deconvolution gefunden, muss ich diese zum Abschluss für jeden Farbkanal, und wenn es das Seeing erlaubte auch für den Luminanzkanal wiederholen. Auch hier hilft Astra Image und bietet Batch-Funktion (Stapelverarbeitung) an.

Farben kombinieren - in Astra Image

LRGB Combine

Astra Image bietet ebenfalls auch die Möglichkeit die einzelnen Kanäle zusammenzuführen zu einem RBG- oder LRBG-Bild. Wie ich bereits gesagt habe ist der Luminanzkanal unverzichtbar, daher nehme ich immer LRGB Combine Methode. Die schaut sehr simpel aus und macht ihren Job super.

|

| AI - LRGB Combine in Astra Image |

Farbbalance - Arbeiten mit dem Histogramm

Astra Image hat einige Möglichkeiten das geschärfte Bild in Sachen Farben und Ton abzustimmen.

|

| AI - Farbenfrohere Jupiter |

Mit nur wenigen Anpassungen mit den Farb-Reglern im Bereich Saturation (hier +80%) und Color Temperature (hier +41%) habe ich aus einem blassen Bild ein doch recht farbenfrohes Ergebnis erzielt.

Am Ende darf man nicht vergessen die Einstellungen dauerhaft zu übernehmen. Danach speichern wir das Ergebnis.

Farben kombinieren - in FitsWork

FitsWork ist ein großartiges und kostenloses Tool für Astronomie! Auch wenn Deconvolution nicht ganz an AI rankommt, so sind andere Funktionen praktisch unverzichtbar. Dafür zahlen andere richtig viel Geld.

Combine 3 B/W Images to RGB Image

Einmal auf alle Farben angewendet erstellt AI eine neue Datei (ich nutze immer das TIF-Format!, am besten in 32-bit Grayscale) für jeden Kanal. Diese sind nun alle gleich geschärft und diese lade ich nun in FitsWork. Dort setze ich in jedem Bild eine Markierung (um das Objekt herum mit der Maus gezogenes Viereck, hier im Bild gelb dargestellt) und führe die Funktion Combine 3 B/W Images to RGB Image. Die Auswahl hilft dabei Fitswork die Bilder besser zu überlagern.

|

| FW - Combine 3 B/W Images to RGB Image |

Man kann gut sehen, dass die einzelnen Farben nicht gleich gut und gleich scharf sind. Einer der Hauptgründe keine Farbkamera für Planetenaufnahmen zu nutzen! Hingegen ist ein ADC für beide Varianten sehr hilfreiche (zu Beginn bereits erwähnt).

FitsWork fragt nun nach jede Farbe (je Aufnahme für RGB) einzeln und man muss die richtige Datei auswählen. Wenn man die Namen gut gewählt hat (oder FireCapture nutzt) und nur diese 3 Dateien in FitsWork offen hat, dann ist das nur eine Formsache...

|

| FW - Auswahl der Dateien pro Farbkanal |

... und wir haben ein RGB-Bild:

|

| FW - Ergebnis von Combine 3 B/W Images to RGB Image |

FW macht die Arbeit mit Bildern sehr leicht. Keins der Bilder wird direkt verändert. Jede Änderung wird in einem neuen Fenster aufgemacht und man braucht keine Angst zu haben seine Daten zu zerschießen. Auch wird bei vielen Funktionen die Berechnung nur auf den markierten Bereich angewendet.

Abstimmung des Bildes - Adjust Colorlayers

Aber was ist mit dem RGB-Bild los? Die Farben liegen nicht übereinander! Auch hier geht es schnell mit FW. Man markiert das Objekt im RGB-Bild und wählt die Funktion Adjust Colorlayers:

|

| FW - Adjust Colorlayers |

Nun habe ich ein gute Übereinstimmung bei den einzelnen Farbschichten...

|

| FW - Farbschichten stimmen, Farben aber nicht! |

... aber noch nicht bei den Farben selbst.

Farbbalance - Arbeiten mit dem Histogramm

Wie man im offenen Histogramm sehen kann, ist die Farbe Rot deutlich weiter in den hellen Bereichen (rechts) als andere Farben. Nun kann man die einzelne Farben auswählen (R G B Knöpfe rechts unten im Histogramm) und den linken und rechten Rand auf den Rotkanal übereinstimmend "ausdehnen".

Achtung: nie die Daten rechts im Histogramm abschneiden! Das macht Fitswork aber gerne automatisch. Aufpassen, dass man alle Daten rechts behält.

Die Bilder sind in der Regel im 16-Bit-FITS-Format oder, wenn ihr wie ich in AI arbeitet, sogar in 32-Bit-TIF(F)-Format abgespeichert, haben also pro Farbkanal min. 65.536 Farben. Achtet darauf am rechten Rand im Histogramm.

Die einzelnen Farben sollte dann am Ende gut übereinstimmen und schauen etwa so aus:

|

| FW - Jeder Kanal ist im Histogramm gleich verteilt |

Da ich immer eine gleiche, feste Anzahl von Frames pro Kanal aufnehme, stimmen bei mir die Farben recht gut überein. Beachtet die Histogramm-Werte bei der Aufnahme am Anfang. Perfekt sind die aber nicht und das Bild ist blass - dazu gleich mehr.

Das Bild wird zwar nun anders angezeigt aber wurde bis jetzt noch nicht verändert! FW ändert keine Bilder einfach so. Erst muss man FW sagen, dass er die Werte nun in ein neues Bild übernimmt. Dazu einfach das Histogramm rechts anklicken und dort auf "Werte übernehmen" klicken. Jetzt erst wird wie immer ein neues Bild erstellt und die Werte wurden neu berechnet. |

| FW - Assign the Scaling to the Image Values! |

Tipp: Wenn die Farben noch nicht stimmen sollten, muss man hier im Histogramm rumspielen oder bei RegiStax die Funktion "HistoRGB Panel - Auto balance" bemühen, welche oft gute Ergebnisse für Planeten liefert. Ich habe nur für diese eine Funktion RegiStax überhaupt noch installiert!

|

| RegiStax6 - HistoRGB Panel - Auto balance |

Wie bereits gesagt, noch ist das Jupiterbild in FW blass. Unter RegiStax schaut es schon anders aus - da habe ich aber auch bereits vorgearbeitet und da wollen wir noch hin!

Sättigung - FW Saturation

Wir sind also immer noch nicht fertig. Die Farben sind einfach viel zu blass. Man kann es zwar so lassen aber kräftigere Farben schaden nicht. Auch hier hilft FitsWork gerne!

Natürlich ist es eine Frage des Geschmacks. Manche mögen diese blasse Farben mehr. Aber etwas mehr Farbe finde ich besser und wähle daher den Wert 150 bei Saturation in FW.

|

| FW - Saturation |

Das Ergebnis kann man bereits in der Vorschau sehen:

|

| FW - Saturation auf 150 |

An dieser Stelle, vielleicht aber auch schon vorher, fallen Farbstiche (das Bild ist zu blau, zu grün oder zu rot) auf. Bei mir hat das Bild deutlichen Blaustich. Auch dass lässt sich mit FW leicht beseitigen. Eine Fläche die grau oder weiß sein sollte mit rechten Maustaste anklicken...

|

| FW - Das Bild mit 2x Saturation |

... und 15x15 Pixel oder Pixel als Weiß kennzeichnen. Nun sollten die Farben stimmen.

Im direkten Vergleich fallen die Farbe positiv auf. Wenn mir das nicht reicht, dann mache ich das noch mal.

In diesem Bild fällt nun das Rauschen auf, das liegt aber hauptsächlich am PNG-Format, welches ich für diese blinkende GIFs nutze. Das wird gleich besser, versprochen.

Luminanz - scharfes sehen!

Das Bild ist bereits ganz gut aber es fehlt noch ein Kanal - Luminanz! Warum ist dieser nun nötig?! Das liegt im Auge des Betrachters.

Grundsätzlich ist Luminanz das Maß für die Helligkeit. Hier aus der Wiki:

"Das Auge kann geringe Helligkeitsunterschiede besser erkennen als kleine Farbtonunterschiede, und diese wiederum besser als kleine Farbsättigungsunterschiede. So ist ein Text grau auf schwarz geschrieben gut zu lesen, blau auf rot geschrieben bei gleicher Grundhelligkeit jedoch nur sehr schlecht."

Anders gesagt: jeder Mensch kann in Farbe weniger Schärfe erkennen. Hingegen sehen wir in Luminanz (S/W) schärfer. Das machen wir uns nun zunutze und da wir bereits eine S/W-Aufnahme mit Rotfilter haben (das hatte ich die ganze Zeit in FW offen gelassen), wird diese direkt als Luminanz missbraucht und ein LRGB (in diesem Fall RRGB) Bild erstellt.

|

| FW - Luminanzbild mit einem RGB-Bild kombinieren |

|

| Luminanz vs synthetischen Luminanz aus RGB |

Ein echter Luminanzfilter (mit einer S/W-Kamera) ist besser, da er mehr Informationen liefert (durchlässt). In unseren Breitengraden, mit den gerade tief liegenden Planeten, ist aber genau das oft auch ein Nachteil - mit dem "normalen" Luminanzfilter ist oft nichts zu holen. Deshalb wird auch ein alternativer Filter eingesetzt, wie z.B. ein ins Rote verschobener IR-Passfilter (685 nm), der die besten Ergebnisse liefert. Oder wie hier im Beispiel der reine R-Filter. Diese haben dennoch weniger Informationen als ein echter Luminanz-Kanal. Aber was will man machen...

Das Ergebnis des L(R)RGB-Bildes vergleichen wir mal mit dem Ausgangsbild (hier der R-Kanal-Stack):

|

| R-Kanal vs L(R)RGB |

Derotation - WinJUPOS

Die Bild zu derotieren bringt erst dann was, wenn die Aufnahme längere Zeit läuft als der Planet für eine sichtbare Drehung auf dem Chip benötigt. Dabei sind die Brennweite und die Pixelgröße der Kamera entscheidend. Bei einer Auflösung von 0.25"/pixel (in meinem Beispielbild sind es 0.28"/pixel) benötigt der Mars etwa 280s, Jupiter 60s und Saturn 150s für eine Drehung die ein Programm wie WinJUPOS erkennen kann.

Wenn man das Programm WinJUPOS das erste mal startet, muss man die Sprache und das Objekt, welches man bearbeiten will, einstellen (hier Jupiter).

Wenn man das Programm WinJUPOS das erste mal startet, muss man die Sprache und das Objekt, welches man bearbeiten will, einstellen (hier Jupiter).

|

| WinJUPOS - Celestial body: Jupiter |

Vermessung - WinJUPOS Image measurement

Danach muss man in WinJUPOS "Image measurement" durchführen:

- Image measurements öffnen

- Im Tab Imag (Alt+I).

- Öffnen (F7) des Video-Vorschaubildes (erstellt FireCapture automatisch pro Aufnahme)

- Das Datum und die UT-Uhrzeit der Mitte der Aufnahme eintragen (das wurde bereits von FireCapture im Filenamen richtig eingetragen, daher einfach abtippen. Oder Filename ist bereits in FireCapture auf WinJUPOS-Standard eingestellt und wird automatisch erkannt)

- Geografische Position richtig eintragen (kann man am besten Speichern)

- Im Tab Opt. (Alt+O)

- Bild-Orientierung (bei mir in der Regel immer mit Norden nach oben)

- Pixelgröße der Kamera

- und Teleskopdaten eintragen (hier hilft SessionBrowser von FireCapture)

WinJUPOS - Kamera- und Teleskopdaten - Im Tab Adj. (Alt+A)

- Unter Channel (F9) den richtigen Wert für Farbkanal einstellen

- Automatische Erkennung (F11) nutzen. Sollte bei guter Auflösung in der Regel immer erkannt werden. Wenn nicht:

- Pfeiltasten für Bewegung in alle Richtungen,

- N für Rotationen in Uhrzeigersinn, P für Rotation gegen Uhrzeigersinn,

- Bild-Hoch und Bild-Runter für Vergrößerung bzw. Verkleinerung)

- LD Compensation ausschalten (Das Thema ist etwas komplexer, ist aber in der Hilfe der Software beschrieben).

- Den Horizont ausrichten (Ctrl+H) und vielleicht noch zentrieren (ist optional)

WinJUPOS - Jupiters Lage automatisch erkannt und horizontal ausgerichtet - Die Vermessung in einem IMS-File speichern (F2)

|

| WinJUPOS - Recording > Image measurments... |

Diese Vermessung muss nicht sehr genau sein. Es reicht, wenn die Ränder gut passen, die Bänder richtig ausgerichtet sind und Nordpol richtig eingestellt ist.

Derotation - WinJUPOS De-rotation of images

Nun muss man für die eigentliche Derotation folgendes in WinJUPOS machen:

- Unter Tools das Derotieren von Bilder öffnen

WinJUPOS - De-rotation of images... - Das vorher erstellte IMS-File öffnen (IMS-File wird in der Regel automatisch gefunden und eingetragen)

- Die größe des Ausgabebildes unter "Quadratic image size" noch so einstellen wie man es haben möchte

- Die Option "Stretch luminescence to maximum dynamic range" setzen

WinJUPOS - De-Rotation of images - Starten der Derotation (F12)

Bei dieser Beispielaufnahme ist die Aufnahmezeit sehr kurz gewesen, sodass die Derotation gar nichts bringt. Je weiter man sich bei der Technik und Aufnahme verbessert, um so länger wird man die Aufnahmen laufen lassen. Erst dann wirkt sich die Derotation aus. Bis etwa 1-2 Minuten langen Aufnahmen kann die Stackingsoftware AutoStakkert bereits von sich aus derotiren.

Und dann sind wir mit dem Planeten Jupiter fertig!!

|

| FC - Fertiges R-RGB-Bild, derotiert |

Tipp: Übrigens, der Rahmen für das fertige Bild ist mit Hilfe von FireCapture erstellt woren. Dazu liefert FC ein Zusatzprogramm namens ImageMagic, wo man aus einem Log seine Aufnahmezeit und Objekt wählt und alle Parameter automatisch eingetragen werden. Hat man sein Teleskop, Standort und Name in FCs Einstellungen eingetragen, dann werden auch diese automatisch übertragen.

Tipp: hat man das Bild derotiert, so sollte man auf jeden Fall das unter Zeitangabe kenntlich machen, in dem man hinter der Aufnahmezeit (die selbst die Mitte der Aufnahme, also z.B. G-Kanal-Zeit) die Gesamtzeit der Aufnahme in Klammern einträgt. In diesem Beispiel habe ich das Bild nicht derotiert veröffentlicht, daher steht dort nur die G-Kanal-Zeit (die Mitte der Aufnahme). Hätte ich es derotiert, müsste dort noch neben 00:06 UT (4m) stehen. Wie man sehen kann, sind bei 4 Minuten kaum bis gar keine Rotation zu erwarten, weshalb man auf das Derotieren hier verzichten kann. Das meiste macht ja bereits AutoStakkert.

Damit wäre die erste Anleitung fertig. Wie es nun weiter bei Mosaik von Mondaufnahmen geht und wo und wie man die Bilder veröffentlichen kann, erfahrt ihr in der nächsten Folge :).

Clear Sky!

Kommentare

Ich habe den Blog mal in der FB-Gruppe "Planetenfotografie" geteilt.

Sehr gut erklärt!!